This is the Windows app named LLamaSharp whose latest release can be downloaded as v0.5.1-GGUF,grammarandsemantic-kernelintegration.zip. It can be run online in the free hosting provider OnWorks for workstations.

Download and run online this app named LLamaSharp with OnWorks for free.

Follow these instructions in order to run this app:

- 1. Downloaded this application in your PC.

- 2. Enter in our file manager https://www.onworks.net/myfiles.php?username=XXXXX with the username that you want.

- 3. Upload this application in such filemanager.

- 4. Start any OS OnWorks online emulator from this website, but better Windows online emulator.

- 5. From the OnWorks Windows OS you have just started, goto our file manager https://www.onworks.net/myfiles.php?username=XXXXX with the username that you want.

- 6. Download the application and install it.

- 7. Download Wine from your Linux distributions software repositories. Once installed, you can then double-click the app to run them with Wine. You can also try PlayOnLinux, a fancy interface over Wine that will help you install popular Windows programs and games.

Wine is a way to run Windows software on Linux, but with no Windows required. Wine is an open-source Windows compatibility layer that can run Windows programs directly on any Linux desktop. Essentially, Wine is trying to re-implement enough of Windows from scratch so that it can run all those Windows applications without actually needing Windows.

SCREENSHOTS

Ad

LLamaSharp

DESCRIPTION

The C#/.NET binding of llama.cpp. It provides APIs to infer the LLaMa Models and deploy it on the local environment. It works on both Windows, Linux and MAC without the requirement for compiling llama.cpp yourself. Its performance is close to llama.cpp. Furthermore, it provides integrations with other projects such as BotSharp to provide higher-level applications and UI.

Features

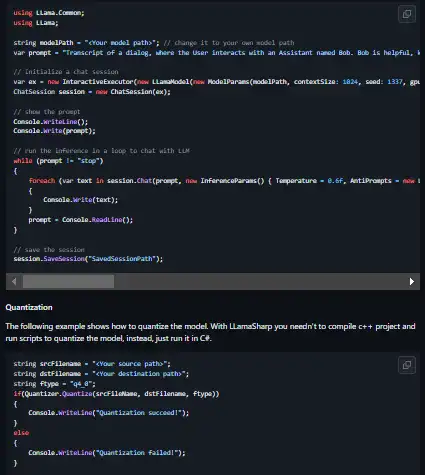

- Model Inference and Chat Session

- LLamaSharp provides two ways to run inference: LLamaExecutor and ChatSession

- With LLamaSharp you needn't to compile c++ project and run scripts to quantize the model, instead, just run it in C#

- We provide the integration of ASP.NET core

- Embeddings generation, tokenization and detokenization

- LLaMa model inference

Programming Language

C#

Categories

This is an application that can also be fetched from https://sourceforge.net/projects/llamasharp.mirror/. It has been hosted in OnWorks in order to be run online in an easiest way from one of our free Operative Systems.