Este é o aplicativo do Windows chamado Make-A-Video - Pytorch (wip), cuja versão mais recente pode ser baixada como 0.2.0.zip. Ele pode ser executado online no provedor de hospedagem gratuito OnWorks para estações de trabalho.

Baixe e execute online este aplicativo chamado Make-A-Video - Pytorch (wip) com OnWorks gratuitamente.

Siga estas instruções para executar este aplicativo:

- 1. Baixe este aplicativo em seu PC.

- 2. Entre em nosso gerenciador de arquivos https://www.onworks.net/myfiles.php?username=XXXXX com o nome de usuário que você deseja.

- 3. Carregue este aplicativo em tal gerenciador de arquivos.

- 4. Inicie qualquer emulador on-line OS OnWorks a partir deste site, mas um emulador on-line melhor do Windows.

- 5. No sistema operacional OnWorks Windows que você acabou de iniciar, acesse nosso gerenciador de arquivos https://www.onworks.net/myfiles.php?username=XXXXX com o nome de usuário que deseja.

- 6. Baixe o aplicativo e instale-o.

- 7. Baixe o Wine de seus repositórios de software de distribuição Linux. Depois de instalado, você pode clicar duas vezes no aplicativo para executá-lo com o Wine. Você também pode experimentar o PlayOnLinux, uma interface sofisticada do Wine que o ajudará a instalar programas e jogos populares do Windows.

Wine é uma forma de executar software Windows no Linux, mas sem a necessidade de Windows. Wine é uma camada de compatibilidade do Windows de código aberto que pode executar programas do Windows diretamente em qualquer desktop Linux. Essencialmente, o Wine está tentando reimplementar o suficiente do Windows do zero para que possa executar todos os aplicativos do Windows sem realmente precisar do Windows.

SCREENSHOTS

Ad

Criar um vídeo - Pytorch (wip)

DESCRIÇÃO

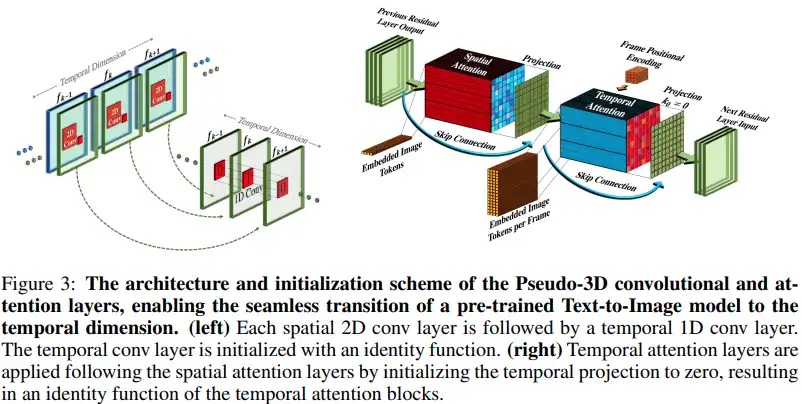

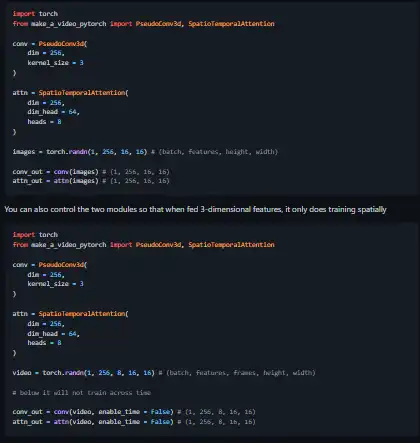

Implementação do Make-A-Video, novo gerador de texto SOTA para vídeo da Meta AI, em Pytorch. Eles combinam convoluções pseudo-3D (convoluções axiais) e atenção temporal e mostram uma fusão temporal muito melhor. As convoluções pseudo-3D não são um conceito novo. Já foi explorado antes em outros contextos, digamos, para previsão de contato de proteínas como "redes residuais híbridas dimensionais". A essência do artigo se resume a pegar um modelo de texto para imagem SOTA (aqui eles usam DALL-E2, mas os mesmos pontos de aprendizado se aplicariam facilmente ao Imagen), fazer algumas pequenas modificações para atenção ao longo do tempo e outras formas para economizar no custo de computação, faça a interpolação de quadros corretamente, obtenha um ótimo modelo de vídeo. Passando imagens (se alguém for pré-treinar as imagens primeiro), tanto a convolução temporal quanto a atenção serão automaticamente ignoradas. Em outras palavras, você pode usar isso diretamente em seu 2d Unet e, em seguida, transferi-lo para um 3d Unet assim que essa fase do treinamento for concluída.

Recursos

- Os módulos temporais são inicializados para gerar a identidade como o papel havia feito

- Você também pode controlar os dois módulos para que, quando alimentados com recursos tridimensionais, ele treine apenas espacialmente

- Full SpaceTimeUnet que é agnóstico para imagens ou treinamento de vídeo, e onde mesmo que o vídeo seja passado, o tempo pode ser ignorado

- Passando imagens (se alguém for pré-treinar as imagens primeiro), tanto a convolução temporal quanto a atenção serão automaticamente ignoradas

- A essência do artigo se resume a, pegue um modelo SOTA text-to-image

- Implementação do Make-A-Video, novo gerador de texto para vídeo SOTA da Meta AI, em Pytorch

Linguagem de Programação

Python

Categorias

Este é um aplicativo que também pode ser obtido em https://sourceforge.net/projects/make-a-video-pytorch.mirror/. Ele foi hospedado em OnWorks para ser executado online da maneira mais fácil a partir de um de nossos Sistemas Operativos gratuitos.