Это приложение для Windows под названием TensorRT, последнюю версию которого можно загрузить как TensorRTOSSv9.1.0sourcecode.zip. Его можно запустить онлайн на бесплатном хостинг-провайдере OnWorks для рабочих станций.

Загрузите и запустите онлайн это приложение под названием TensorRT с OnWorks бесплатно.

Следуйте этим инструкциям, чтобы запустить это приложение:

- 1. Загрузил это приложение на свой компьютер.

- 2. Введите в нашем файловом менеджере https://www.onworks.net/myfiles.php?username=XXXXX с желаемым именем пользователя.

- 3. Загрузите это приложение в такой файловый менеджер.

- 4. Запустите любой онлайн-эмулятор OS OnWorks с этого сайта, но лучше онлайн-эмулятор Windows.

- 5. В только что запущенной ОС Windows OnWorks перейдите в наш файловый менеджер https://www.onworks.net/myfiles.php?username=XXXXX с желаемым именем пользователя.

- 6. Скачайте приложение и установите его.

- 7. Загрузите Wine из репозиториев программного обеспечения вашего дистрибутива Linux. После установки вы можете дважды щелкнуть приложение, чтобы запустить его с помощью Wine. Вы также можете попробовать PlayOnLinux, необычный интерфейс поверх Wine, который поможет вам установить популярные программы и игры для Windows.

Wine - это способ запустить программное обеспечение Windows в Linux, но без Windows. Wine - это уровень совместимости с Windows с открытым исходным кодом, который может запускать программы Windows непосредственно на любом рабочем столе Linux. По сути, Wine пытается заново реализовать Windows с нуля, чтобы можно было запускать все эти Windows-приложения, фактически не нуждаясь в Windows.

СКРИНШОТЫ

Ad

ТензорРТ

ОПИСАНИЕ

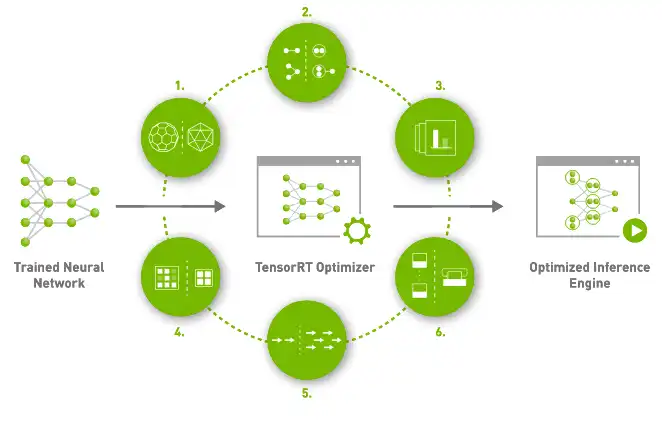

NVIDIA® TensorRT ™ - это SDK для высокопроизводительного вывода данных глубокого обучения. Он включает оптимизатор вывода глубокого обучения и среду выполнения, которая обеспечивает низкую задержку и высокую пропускную способность для приложений вывода глубокого обучения. Приложения на основе TensorRT во время логического вывода работают до 40 раз быстрее, чем платформы, использующие только ЦП. С помощью TensorRT вы можете оптимизировать модели нейронных сетей, обученные во всех основных средах, откалибровать для более низкой точности с высокой точностью и развернуть в гипермасштабируемых центрах обработки данных, встроенных или автомобильных платформах. TensorRT построен на CUDA®, модели параллельного программирования NVIDIA, и позволяет вам оптимизировать использование логических выводов, используя библиотеки, инструменты разработки и технологии в CUDA-X ™ для искусственного интеллекта, автономных машин, высокопроизводительных вычислений и графики. С новыми графическими процессорами NVIDIA Ampere Architecture в TensorRT также используются разреженные тензорные ядра, обеспечивающие дополнительный прирост производительности.

Особенности

- TensorRT предоставляет INT8 с использованием обучения с учетом квантования и квантования после обучения

- Производственные развертывания приложений логического вывода глубокого обучения, таких как потоковое видео, распознавание речи, рекомендации и т. Д.

- Сниженная точность вывода значительно снижает задержку приложения

- С TensorRT разработчики могут сосредоточиться на создании новых приложений на базе искусственного интеллекта, а не на настройке производительности для развертывания логического вывода.

- Максимизирует пропускную способность с FP16 или INT8 за счет квантования моделей при сохранении точности

- Оптимизирует использование памяти и пропускной способности графического процессора за счет объединения узлов в ядре

Язык программирования

C + +

Категории

Это приложение также можно загрузить с https://sourceforge.net/projects/tensorrt.mirror/. Он размещен в OnWorks, чтобы его можно было легко запускать в сети с помощью одной из наших бесплатных операционных систем.